دراسة: ضجيج الذكاء الاصطناعي يُعيق البحث الحقيقي في مجال الذكاء الاصطناعي

نُشرت دراسة جديدة من جمعية النهوض بالذكاء الاصطناعي (AAAI) هذا الشهر، شارك فيها مئات من الباحثين في مجال الذكاء الاصطناعي، وكانت النتيجة الرئيسية هي: إن نهجنا الحالي للذكاء الاصطناعي من غير المرجح أن يؤدي بنا إلى الذكاء الاصطناعي العام.

كان الذكاء الاصطناعي موضوعًا شائعًا للحديث خلال العامين الماضيين، لكن مجال الذكاء الاصطناعي كبحث علمي موجود منذ عقود. على سبيل المثال، تم نشر ورقة “آلات الحوسبة والذكاء” الشهيرة لألان تورينج واختبار تورينج الذي ما زلنا نتحدث عنه اليوم، في عام 1950.

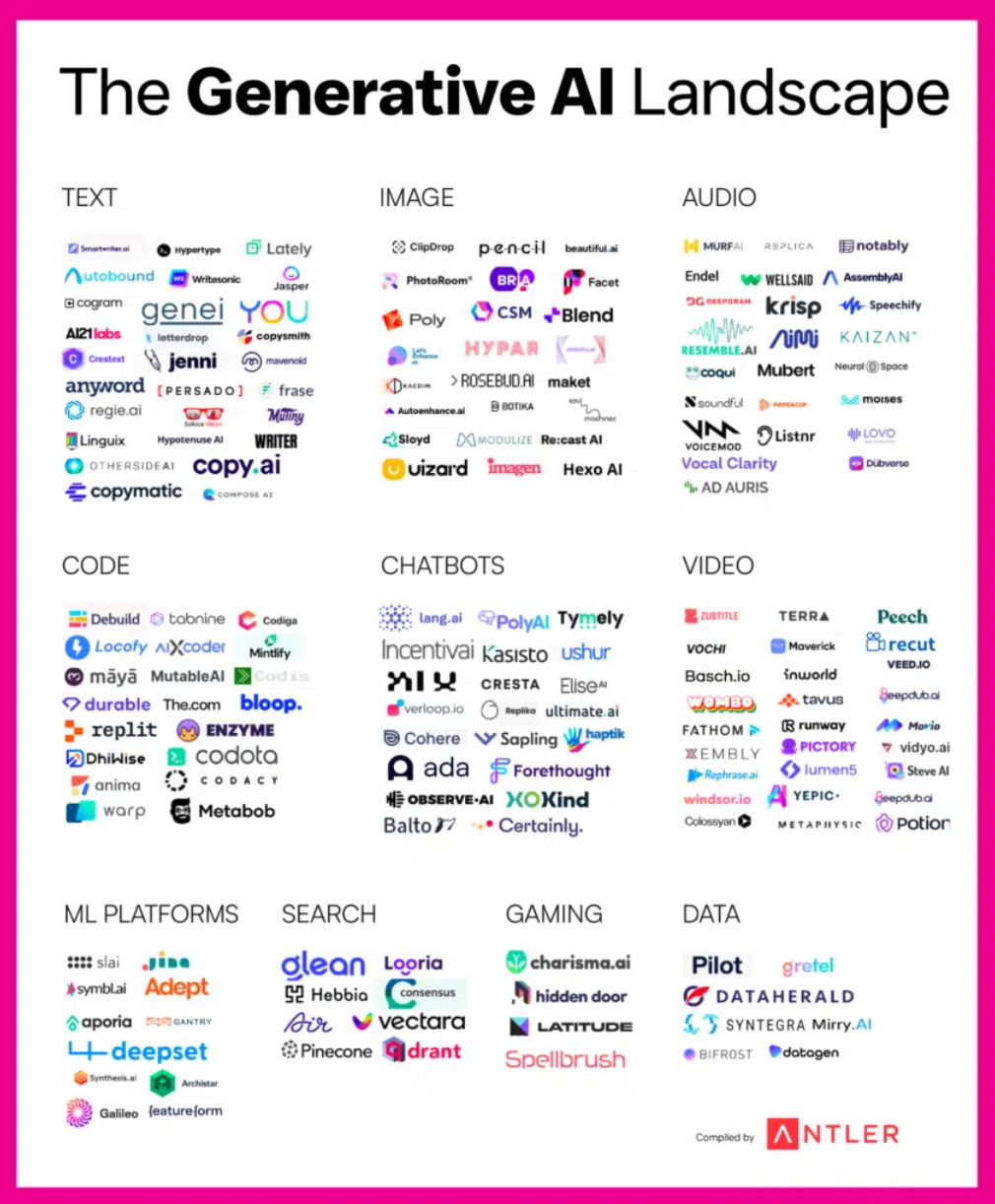

وُلد الذكاء الاصطناعي الذي يتحدث عنه الجميع اليوم من هذه العقود من البحث، لكنه أيضًا يبتعد عنهم. بدلاً من كونه بحثًا علميًا، لدينا الآن أيضًا فرعًا متباينًا من الذكاء الاصطناعي يمكن أن نطلق عليه “الذكاء الاصطناعي التجاري”.

تُقود شركات الاحتكار الكبرى مثل مايكروسوفت وجوجل وميتا وأبل وأمازون جهود الذكاء الاصطناعي التجاري، وهدفها الأساسي هو إنشاء منتجات الذكاء الاصطناعي. لا ينبغي أن يكون هذا مشكلة، لكن يبدو في الوقت الحالي أنه قد يكون كذلك.

أولاً، نظرًا لأن معظم الناس لم يتابعوا أبحاث الذكاء الاصطناعي إلا منذ عامين، فإن كل ما يعرفه الشخص العادي عن الذكاء الاصطناعي يأتي من هذه الشركات، وليس من المجتمع العلمي. تغطي الدراسة هذا الموضوع في فصل “تصور الذكاء الاصطناعي مقابل الواقع”، حيث يعتقد 79٪ من العلماء المشاركين أن التصورات الحالية لقدرات الذكاء الاصطناعي لا تتطابق مع واقع أبحاث وتطوير الذكاء الاصطناعي.

بعبارة أخرى، لا يتطابق ما يعتقد الجمهور العام أن الذكاء الاصطناعي يمكنه فعله مع ما يعتقد العلماء أن الذكاء الاصطناعي يمكنه فعله. والسبب في ذلك بسيط مثلما هو مؤسف: عندما يدلي ممثل كبير في مجال التكنولوجيا بتصريح عن الذكاء الاصطناعي، فإنه ليس رأيًا علميًا – إنه تسويق للمنتج. إنهم يريدون تضخيم التكنولوجيا التي تدعم منتجاتهم الجديدة والتأكد من أن الجميع يشعر بالحاجة للقفز على هذه العربة.

عندما يقول سام ألتمان أو مارك زوكربيرج إن وظائف هندسة البرمجيات ستُستبدل بالذكاء الاصطناعي، على سبيل المثال، فإن ذلك يرجع إلى رغبتهم في التأثير على المهندسين لتعلم مهارات الذكاء الاصطناعي والتأثير على شركات التكنولوجيا للاستثمار في خطط المؤسسات باهظة الثمن. ومع ذلك، ما لم يبدأوا في استبدال مهندسيهم (واستفادة من ذلك)، شخصيًا لن أصدق كلمة واحدة يقولونها عن هذا الموضوع.

ومع ذلك، ليس فقط تصور الجمهور هو الذي يؤثر عليه الذكاء الاصطناعي التجاري. يعتقد المشاركون في الدراسة أن “ضجة الذكاء الاصطناعي” التي تصنعها شركات التكنولوجيا الكبرى تضر بجهود البحث. على سبيل المثال، يوافق 74٪ على أن اتجاه أبحاث الذكاء الاصطناعي مدفوع بهذه الضجة – ويرجع ذلك على الأرجح إلى أن البحث الذي يتماشى مع أهداف الذكاء الاصطناعي التجاري أسهل في تمويله. كما يعتقد 12٪ أن أبحاث الذكاء الاصطناعي النظرية تعاني نتيجة لذلك.

إذن، ما مدى خطورة هذه المشكلة؟ حتى لو كانت شركات التكنولوجيا الكبرى تؤثر على نوع البحث الذي نقوم به، فمن المفترض أن المبالغ الضخمة للغاية التي تضخها في هذا المجال يجب أن يكون لها تأثير إيجابي بشكل عام. ومع ذلك، فإن التنوع هو المفتاح عندما يتعلق الأمر بالبحث – نحن بحاجة إلى متابعة جميع أنواع المسارات المختلفة ليكون لدينا فرصة في العثور على أفضل مسار.

لكن شركات التكنولوجيا الكبرى تركز حقًا على شيء واحد فقط في الوقت الحالي – نماذج اللغة الكبيرة. هذا النوع المحدد للغاية من نماذج الذكاء الاصطناعي هو ما يدعم جميع منتجات الذكاء الاصطناعي الأحدث تقريبًا، ويعتقد أشخاص مثل سام ألتمان أن زيادة مقياس هذه النماذج أكثر فأكثر (أي إعطائها المزيد من البيانات، والمزيد من وقت التدريب، والمزيد من قوة الحوسبة) ستمنحنا في النهاية ذكاءً اصطناعيًا عامًا.

تقول هذه الفكرة، التي تُعرف باسم فرضية المقياس، إن كلما زادت القوة التي نُغذيها للذكاء الاصطناعي، زادت قدراته المعرفية وانخفضت معدلات أخطائه. تقول بعض التفسيرات أيضًا إن القدرات المعرفية الجديدة ستظهر بشكل غير متوقع. لذلك، على الرغم من أن نماذج اللغة الكبيرة ليست جيدة في التخطيط والتفكير في المشكلات في الوقت الحالي، يجب أن تظهر هذه القدرات في مرحلة ما.

there is no wall

— Sam Altman (@sama) November 14, 2024

ومع ذلك، في الأشهر القليلة الماضية، واجهت فرضية التوسع انتقادات شديدة. يعتقد بعض العلماء أن توسيع نطاق نماذج اللغات الكبيرة لن يؤدي أبدًا إلى الذكاء الاصطناعي العام، ويعتقدون أن كل القوة الإضافية التي نقدمها لـ نماذج جديدة لم تعد تُنتج نتائج. بدلاً من ذلك، اصطدمنا بـ “جدار التوسع” أو “حد التوسع” حيث تؤدي كميات كبيرة من قوة الحوسبة والبيانات الإضافية إلى تحسينات طفيفة فقط في النماذج الجديدة. معظم العلماء الذين شاركوا في دراسة AAAI هم على هذا الجانب من الحجة:

أكد غالبية المستجيبين (76%) أن “توسيع نطاق نهج الذكاء الاصطناعي الحالي” لتحقيق الذكاء الاصطناعي العام “غير مرجح” أو “غير مرجح للغاية” للنجاح، مما يشير إلى الشكوك حول ما إذا كانت نماذج التعلم الآلي الحالية كافية لتحقيق الذكاء العام.

يمكن لأنظمة اللغات الكبيرة الحالية إنتاج ردود ذات صلة ومفيدة للغاية عندما تسير الأمور على ما يرام، لكنها تعتمد على مبادئ رياضية للقيام بذلك. يعتقد العديد من العلماء أننا سنحتاج إلى خوارزميات جديدة تستخدم المنطق والعقل والمعرفة الواقعية للوصول إلى حل إذا أردنا التقدم نحو هدف الذكاء الاصطناعي العام. إليك اقتباس لاذع عن أنظمة اللغات الكبيرة والذكاء الاصطناعي العام من ورقة بحثية عام 2022 بقلم جاكوب براوننج ويان ليكون.

نظام مُدرّب على اللغة وحده لن يقترب أبدًا من الذكاء البشري، حتى لو تم تدريبه من الآن وحتى موت الحرارة في الكون.

ومع ذلك، لا توجد طريقة حقيقية لمعرفة من هو على حق هنا – ليس بعد. فمن ناحية، فإن تعريف الذكاء الاصطناعي العام ليس ثابتًا، وليس الجميع يسعى إلى نفس الشيء. يعتقد بعض الناس أن الذكاء الاصطناعي العام يجب أن ينتج استجابات تشبه الإنسان من خلال أساليب تشبه الإنسان – لذلك يجب أن يراقب العالم من حولهم ويحل المشكلات بطريقة مشابهة لنا. بينما يعتقد آخرون أن الذكاء الاصطناعي العام يجب أن يركز بشكل أكبر على الاستجابات الصحيحة بدلاً من الاستجابات التي تشبه الإنسان، وأن الأساليب التي يستخدمونها لا ينبغي أن تكون مهمة.

ومع ذلك، من نواحٍ عديدة، لا يهم حقًا أي إصدار من الذكاء الاصطناعي العام تهتم به أو ما إذا كنت مع أو ضد فرضية التوسع – فنحن ما زلنا بحاجة إلى تنويع جهودنا البحثية. إذا ركزنا فقط على توسيع نماذج اللغات الكبيرة، فسيتعين علينا البدء من الصفر إذا لم تنجح، وقد نفشل في اكتشاف طرق جديدة أكثر فعالية أو كفاءة. يخشى العديد من العلماء المشاركين في هذه الدراسة أن يؤدي الذكاء الاصطناعي التجاري والدعاية المحيطة به إلى إبطاء التقدم الحقيقي – لكن كل ما يمكننا فعله هو الأمل في معالجة مخاوفهم وأن يتمكن كلا فرعي بحث الذكاء الاصطناعي من التعايش والتقدم معًا. حسنًا، يمكنك أيضًا أن تأمل في أن فقاعة الذكاء الاصطناعي تنفجر وتختفي جميع المنتجات التكنولوجية التي تعمل بالذكاء الاصطناعي في غياهب النسيان، إذا كنت تفضل ذلك.